На краснодарском конкурсе ScienseSlam, где молодые учёные коротко, доступно и остроумно представляют свои исследования, а победителя выбирают по громкости аплодисментов, математик Алевтина Шаталова рассказывала о том, можно ли научить компьютер интуиции. Оказывается, есть математические методы, позволяющие сделать это. Но если искусственный интеллект научится шутить, различать эмоции, плакать, веселиться, то что же будет отличать его от человека?

Запрограммировать эмоции

Федор Пономарев, «АиФ-Юг»: Алевтина, электронные помощники плотно вошли в нашу жизнь - они помогают объехать пробки, бронируют отели, заказывают билеты, распознают лица и т.д. А что искусственный разум ещё не умеет делать?

- Разве можно научить электронную машину шутить, распознавать, хорошая шутка или плохая? Разве это не наше, человеческое, умение?

- Конечно, можно. Человек может научить компьютер всему, что умеет сам - здесь нет никакой мистики, это просто вопрос адекватных алгоритмов. Дело в том, что не все люди могут распознавать эмоции, понимать шутки. Все мы разные - кто-то, например, мастер ведения переговоров. Но это не дар, а всего лишь навык, который можно смоделировать, разбить на алгоритмы. То же самое можно сделать и с чувством юмора. Правда, оно не бывает «само по себе» - для разной целевой аудитории разные шутки. Так даже проще - на основе математической статистики для компьютера мы можем быстро объяснить, какой юмор приемлем для одной группы людей, какой - для другой.

- Но даже определить эти целевые аудитории непросто, а если компьютер ошибётся в том, для кого шутит, то шутка будет неуместной в лучшем случае?

- Ничего страшного - и человеческие шутки часто бывают неуместными. Недавно я была на съёмках юмористической передачи, и там тоже шутки тестируют на людях - одна зашла, другая нет. Точно так же неуместно может пошутить и робот. Научить машину шутить сложно вовсе не потому, что это юмор невозможно смоделировать. Просто мы сами сложные, и когда с помощью алгоритмов пытаемся объяснить компьютеру, что такое юмор, то, на самом деле, объясняем это в первую очередь себе.

Мы думаем, что куры - глупые создания только потому, что они не посвящают нас в свои планы.

Как судит компьютер

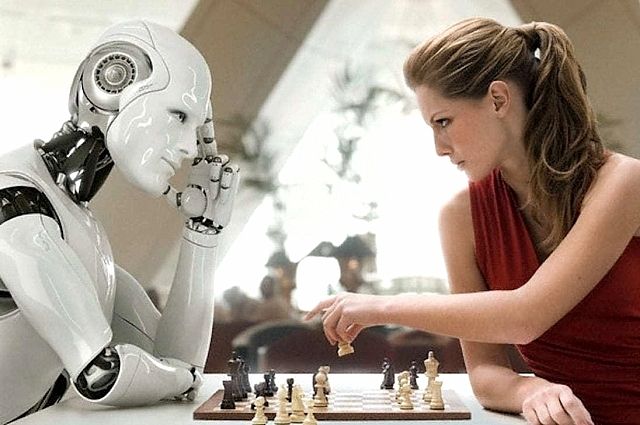

- Если компьютер можно обучить всему, включая чувство юмора, значит, он может стать таким же, как человек?

- И даже лучше. Мы слишком эгоцентричны, уверены в своей неповторимости, уникальности. Думаем, что такие классные только из-за того, что у нас есть душа, которую невозможно смоделировать. Мы совершаем ошибки и даже любуемся ими, мол, мы же люди, а не машины. Но такой путь ведёт к деградации. Поэтому машина, созданная человеком, может быть лучше его самого.

- Одна из излюбленных дилемм фантастики - как понять, что робот перерос себя? Одна из основных версий - что «очеловечивается» машина в момент осознания собственного я?

- В какой момент машина перестаёт быть машиной - неизвестно. Насчёт осознания, я думаю, это утопия. Люди уверены, что только они могут осознавать себя. Я математик, а не зоолог, но если моего кота намазать зелёнкой, он не выйдет на улицу. Животные так же могут узнавать себя в зеркале. Как заметила известный ученый Татьяна Черниговская в своей лекции: мы думаем, что куры - глупые создания только потому, что они не посвящают нас в свои планы. И наше человеческое Эго, потакание собственным слабостям заставляют нас заблуждаться. Математике, слава Богу, это не свойственно. Учёные здесь не прячут субъективность под маску неоспоримой истины, а просто называют их аксиомами. Мы договорились, что параллельные прямые не пересекаются - в Евклидовой геометрии мы в это верим. Если не хотим верить - идём в геометрию Лобачевского. Математика мне нравится тем, что ей не свойственна мораль, идеологические принципы, философские вопросы – всё это математическое моделирование не интересует.

- Вы говорите о человеческих ошибках, но ошибаются и роботы - недавно беспилотная машина насмерть сбила человека.

-Начнём с того, что искусственный интеллект (ИИ) - понятие общее, под которым каждый понимает что-то своё. Сейчас большинство под ИИ понимает машины, работающие на базе алгоритма нейронных сетей. Хотя искусственный интеллект может и не использовать человеческие способы мышления. Нейронные сети интересны тем, что их основной алгоритм похож на принцип работы нашего мозга - мы впервые видим собаку, она гавкает, и мы делаем вывод, что все собаки лают. При этом человеку свойственны когнитивные искажения - если собака укусила человека, то он будет бояться всех. Но ведь не все собаки кусают. Человек выделяет то, что наиболее раздражает глаз, компьютеру это не свойственно, он «видит» всё. То есть, даже с тем же алгоритмом, что и у человека, машина будет принимать более безошибочные решения, без когнитивных искажений.

Часто родители жалуются на компьютерную зависимость своих чад, но в современном мире, если человека нет в Интернете, значит, его просто не существует.

В судебных учреждениях США начали внедрять систему искусственного интеллекта, помогающую судьям избирать меру пресечения обвиняемым по уголовным делам (программно-аппаратный комплекс PSA (Public Safety Assessment, система оценки общественной безопасности). Человек думает, что принимает объективные решения, но это иллюзия. Нам только кажется, что мы взвешиваем все за и против, хотя на самом деле мы изначально предвзяты. Как показал эксперимент нейробиолога Бенджамина Либета, мозг готовится к действию задолго до того, как мы принимаем осознанное решение совершить его. Не стоит противопоставлять человека компьютеру - машина думает точно так же, как человек, написавший для него программу. Проще говоря, человек с помощью компьютера убирает ошибки, свойственные своей натуре.

Восстанут ли машины

- Алевтина, стоит ли нам бояться того, что машины выйдут из-под контроля и восстанут, как в «Терминаторе»?

- Не знаю, но учёных этот вопрос не интересует. Если машины когда-то восстанут, то есть мы создадим роботов, способных превзойти людей, учёные будут счастливы, как дети, от того, что получилось (улыбается). Смысл науки в том, чтобы делать исследовательские, бесстрашные шаги в неизвестность, а вовсе не в ограничении «как бы чего не вышло».

- Восстание машин - фантастическая страшилка, но писатель Николас Карр в книге «Стеклянная клетка» уверяет, что мы уже находимся в плену у машин, но не замечаем этого - отсутствие решёток в нашей цифровой тюрьме создаёт у нас иллюзию свободы. Так ли это?

- Если называть эти ограничения пленом, то да, мы в плену. Но в таком случае и до появления машин мы находились в плену - морали, социума и т.д. Вообще ограничения - естественная среда человека, мы порой сами себе их придумываем. Это хорошо видно в воспитании детей, когда с самого раннего возраста мы ставим им определённые рамки.

- Возвращаясь к искусственному интеллекту - его обучают так же, как ребёнка?

- Да, принципы те же - на основе опыта, но всё происходит гораздо быстрее. Плюс мы можем увидеть сам процесс. А на ребёнка мы смотрим взрослыми глазами и не знаем, что происходит у него в голове. Мы вспоминаем, что думали сами в этом возрасте, представляем, но мир-то уже поменялся. У детей сейчас другие мозги - компьютер их изменил. Часто родители жалуются на компьютерную зависимость своих чад, но в современном мире, если человека нет в Интернете, значит, его просто не существует. Так что зависимость от сети, гаджетов - это социально обусловленная вещь, такая же зависимость, как, например, от горячей воды.

Редактирование генов не миф. Ученый о ГМО, мутации и клонировании людей

Редактирование генов не миф. Ученый о ГМО, мутации и клонировании людей  «Российской науке нужен пиар». Молодой ученый о Маске и новых Циолковских

«Российской науке нужен пиар». Молодой ученый о Маске и новых Циолковских  Время изобретать. Кто сегодня создает дороги в нанобудущее?

Время изобретать. Кто сегодня создает дороги в нанобудущее?  Овощи и фрукты защитят от рака? Онколог о новых исследованиях ученых

Овощи и фрукты защитят от рака? Онколог о новых исследованиях ученых